Не каждый VPS выдержит AI: чем LLM-нагрузки отличаются от обычных серверных задач

Когда говорят про AI или LLM, часто кажется, что для любой такой нагрузки сразу нужен дата-центр, стойка с GPU и огромный бюджет. Но на практике многое можно запустить и на VPS — вопрос в том, какой именно сценарий вы хотите там разместить.

Допустим, вы решили поднять собственный AI-сервис в духе ChatGPT как рабочий инструмент для клиентов, сотрудников или внутренней базы знаний. Снаружи идея выглядит просто: берём модель, разворачиваем её на VPS и даём доступ через API или чат. Но именно здесь и выясняется, что LLM-нагрузка живёт по другим правилам, чем обычный backend или корпоративный сайт.

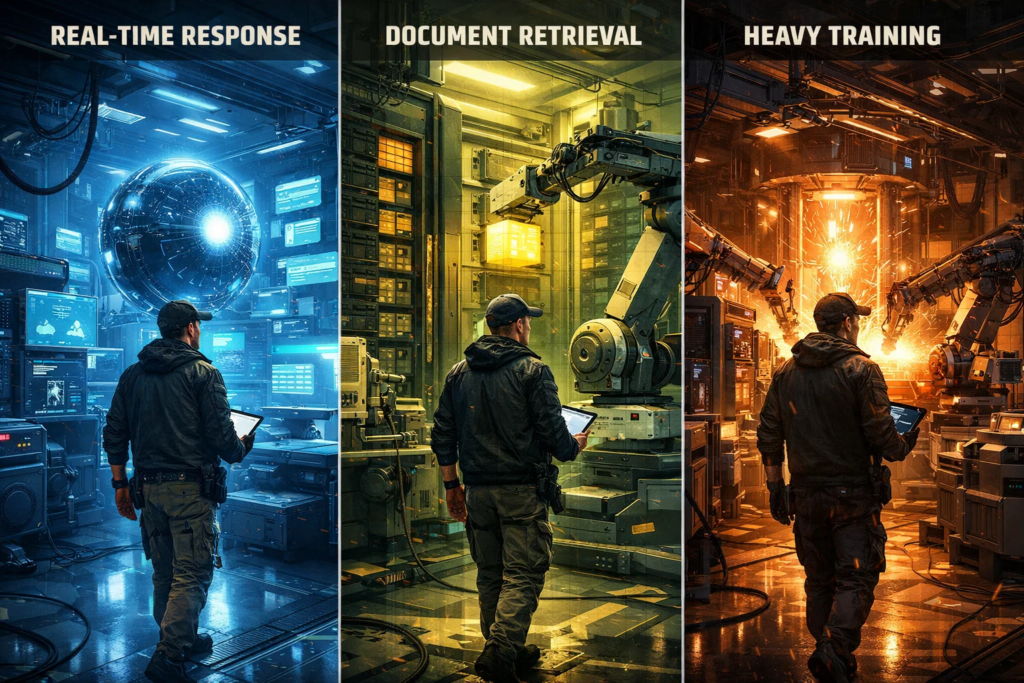

Сегодня далеко не всем нужен fine-tuning или обучение модели с нуля. Зато многим нужны более прикладные сценарии:

- Inference для пользовательских запросов;

- RAG с внутренними документами и базами знаний;

- Batch-обработка текстов, изображений или логов;

- Транскрибация аудио (например звонков в отдел продаж);

- Классификация, суммаризация и извлечение данных;

- Локальные API-обёртки для моделей и AI-функций внутри сервиса.

Для таких задач нередко хватает грамотно выбранного GPU-VPS или даже обычной VPS. Но отличие LLM-нагрузки в том, что сервер упирается не только в CPU и RAM. Значение имеют размер модели, объём доступной памяти, длина контекста, скорость чтения весов, поведение кэша и то, помещается ли модель целиком в GPU-память или начинает уходить в системную память и CPU.

Поэтому AI-нагрузка на VPS — это не просто “машина помощнее”. Один и тот же сервер может нормально тянуть лёгкий inference, но начать задыхаться на длинном контексте, параллельных запросах или более тяжёлой модели. А иногда узким местом окажется не GPU, а диск или сеть, особенно если модель работает в связке с внешними данными и RAG.

Практический вывод простой: AI на VPS — это реально, но только если идти не от абстрактного слова “AI”, а от конкретного сценария. Малые и средние inference-задачи, локальные API, RAG, batch-обработка и часть MLOps-обвязки вполне могут жить на VPS. А серьёзный fine-tuning тяжёлых моделей и обучение с нуля — это уже другая история с заметно более высокими требованиями.

Сначала сценарий, потом сервер: inference, RAG, fine-tuning и фоновые пайплайны

Одна из самых частых ошибок в AI-инфраструктуре проста: команда сначала выбирает сервер, а уже потом пытается понять, что именно на нём будет работать. В итоге кто-то берёт “VPS помощнее” под чат-бота, кто-то рассчитывает на fine-tuning там, где сервер еле тянет обычный inference, а кто-то переплачивает за GPU, хотя задача в основном упирается в CPU, диск и организацию пайплайна.

С AI лучше идти в обратную сторону: сначала сценарий, потом сервер. Под словом “AI-нагрузка” часто скрываются очень разные задачи, а значит и требования к инфраструктуре у них тоже разные. Чаще всего речь идёт о четырёх сценариях:

- Inference — модель отвечает на запросы пользователей;

- RAG — модель работает с документами, базой знаний или внутренними данными;

- Fine-tuning — модель дообучают под конкретную задачу;

- Фоновые пайплайны — batch-обработка, эмбеддинги, OCR, индексация и классификация.

На бумаге всё это легко назвать “работой с LLM”, но на практике разница между сценариями большая. Для inference важно, помещается ли модель в память, какой нужен контекст и сколько запросов приходит одновременно. В RAG модель — только часть цепочки, поэтому сервер может упираться не только в inference, но и в диск, сеть, базу векторов и обработку данных вокруг неё.

Fine-tuning — это уже другой класс нагрузки: сервер должен не только держать модель в памяти, но и тянуть процесс дообучения, а требования к GPU и памяти здесь растут заметно быстрее. Фоновые пайплайны выглядят менее эффектно, но тоже легко съедают ресурсы: ночная обработка документов, эмбеддинги, OCR или переиндексация базы знаний могут сильно нагружать CPU, диск и память даже без “живого” чата.

Главный вывод простой: один и тот же сервер может хорошо подходить для одного сценария и быть неудачным для другого. Поэтому перед выбором VPS полезно сначала ответить на прямой вопрос — что именно вы хотите запускать: чат, поиск по документам, дообучение или служебные пайплайны вокруг модели. Пока этого ответа нет, разговор о железе почти всегда преждевременен.

Что на самом деле выбирать: CPU, RAM, NVMe, GPU и узкие места всей цепочки

Когда сценарий уже понятен, появляется следующий вопрос: на что именно смотреть в сервере. И вот здесь многие снова попадают в ловушку. Кто-то упирается только в GPU, будто всё остальное неважно. Кто-то, наоборот, пытается решить LLM-задачу “побольше оперативки и норм”. На практике AI-нагрузка почти всегда чувствительна сразу к нескольким компонентам, и слабое место может оказаться совсем не там, где его ждали.

Это можно свести к простой логике:

| Компонент | За что отвечает | Где чаще всего становится узким местом |

| CPU | Подготовка запросов, фоновые задачи, часть inference, работа пайплайнов | RAG, batch-обработка, OCR, эмбеддинги, CPU-only сценарии |

| RAM | Хранение модели, данных, промежуточных результатов и обвязки вокруг неё | Большие модели без GPU, RAG, сервисы с несколькими процессами |

| NVMe | Быстрая загрузка весов, датасетов, индексов и рабочих файлов | Долгий старт модели, медленные пайплайны, работа с большими наборами данных |

| GPU | Быстрый inference и тяжёлые AI-сценарии | Чат в реальном времени, длинный контекст, параллельные запросы, fine-tuning |

| Вся цепочка целиком | Связь модели, диска, памяти, сети и сервисов вокруг неё | RAG, production-сервисы, многокомпонентные пайплайны |

Таблица выше показывает главный принцип: в AI-сценариях почти никогда не хватает взгляда на один параметр. Даже если GPU выглядит достаточно мощным, сервис всё равно может упереться в память, диск, CPU или в саму связку компонентов вокруг модели.

На практике узкое место зависит от сценария. Inference чаще чувствителен к GPU и памяти, RAG — к диску, RAM и базе векторов, batch-процессы — к CPU и обработке данных, а production-сервис для пользователей обычно упирается сразу в несколько участков цепочки. Поэтому хороший VPS для AI выбирают не по самой громкой характеристике, а по тому, выдерживает ли вся конфигурация конкретную нагрузку целиком.

Сеть и данные: почему модель упирается не только в железо

На этом этапе легко решить, что главное уже понятно: выбрали сценарий, посмотрели на CPU, RAM, NVMe и GPU — значит, сервер подобран. Но в реальной работе AI-сервис почти никогда не живёт в вакууме. Модели постоянно нужно получать данные, обращаться к соседним сервисам, подтягивать контекст и сохранять результаты. Поэтому даже хороший сервер может вести себя медленно, если вся цепочка вокруг него собрана неудачно.

Это особенно заметно в сценариях с RAG. На бумаге всё выглядит просто: модель поднята, памяти хватает, GPU есть. Но реальный запрос редко ограничивается только inference. Система идёт в базу знаний, поднимает документы, собирает контекст, передаёт его в модель, а потом ещё логирует и сохраняет результат. Формально это один запрос, а по факту — целая цепочка обращений к данным и сервисам.

Это можно представить так:

| Что происходит вокруг модели | Как это бьёт по сервису |

| Данные лежат далеко от сервера | Растёт задержка на каждом обращении |

| RAG тянет тяжёлые документы или куски контекста | Ответ собирается дольше, чем ожидает пользователь |

| Хранилище или база индексов работают медленно | Модель простаивает, пока ждёт данные |

| Egress-трафик дорогой или плохо учтён | Стоимость сервиса растёт быстрее, чем кажется |

| Нет private networking между компонентами | Увеличиваются задержки и поверхность риска |

| Бэкапы, снапшоты и загрузка датасетов устроены хаотично | Эксплуатация становится медленной и нервной |

Из-за этого сеть и данные часто влияют на результат не слабее самого железа. Если база знаний лежит далеко, векторное хранилище отвечает с задержкой, а запрос проходит через несколько разнесённых сервисов, модель начинает ждать. В итоге сервис тормозит не потому, что сама модель слишком тяжёлая, а потому что маршрут данных оказался длинным и дорогим.

На практике это хорошо видно в двух типах конфигураций:

- Мощный GPU-VPS, но удалённые данные, длинная цепочка запросов и лишние сетевые переходы;

- Более скромный сервер, но короткий путь к данным, аккуратная сеть и меньше лишних шагов.

Во втором случае пользовательский опыт нередко оказывается лучше, даже если “по железу” такой сервер выглядит слабее. Поэтому в AI часто выигрывает не тот, кто просто взял VPS помощнее, а тот, кто собрал более короткий и понятный маршрут данных.

Есть и второй слой проблемы — стоимость. Когда данные активно ходят между регионами, зонами или сервисами, в игру вступает egress. Поэтому сеть влияет не только на задержку, но и на TCO всей схемы.

Практический вывод здесь простой: перед запуском нужно проверять не только сервер, но и всю схему движения данных. Где лежат документы, как подключены базы, есть ли private networking, сколько стоит межсервисный трафик и не тратит ли модель половину времени не на генерацию, а на ожидание и перегонку данных.

Что проверить до запуска: доступы, изоляция, стоимость, масштабирование и запас по росту

Даже если модель уже запускается, RAG отвечает, а команда довольна пилотом, это ещё не значит, что схема готова к нормальной эксплуатации. На старте AI-сервис легко выглядит аккуратным и недорогим, но после первого роста нагрузки часто выясняется, что проблемы были не в самом запуске, а в окружении вокруг него.

Перед выходом в реальную работу полезно проверить пять вещей:

- Доступы. Кто может заходить на сервер, в панель управления, в логи, в базу документов, в API и в хранилища? Для AI-сервисов это особенно важно, потому что рядом с моделью часто лежат чувствительные документы, история запросов, системные промпты и ключи от внешних сервисов.

- Изоляция. Живёт ли нагрузка отдельно или крутится рядом с другими сервисами? Если на одном сервере одновременно сидят модель, база, служебные скрипты и внутренние панели, то при первом всплеске нагрузки они начинают мешать друг другу.

- Стоимость. Сколько стоит не один сервер в вакууме, а вся схема целиком: с трафиком, бэкапами, логами, хранением данных, окружениями, мониторингом и фоновыми задачами? Именно здесь часто выясняется, что “дёшево запустить” и “дёшево поддерживать” — разные вещи.

- Масштабирование. Что будет, если пользователей станет больше, контекст вырастет, появится вторая модель или RAG начнёт работать не по сотне документов, а по десяткам тысяч? Хорошая инфраструктура должна иметь понятный следующий шаг, а не держаться на пределе уже в пилоте.

- Запас по росту. Не бесконечный оверпровижининг, а нормальный инженерный запас. AI-сервис редко остаётся таким же, как в первой демке: растёт нагрузка, усложняется логика, добавляются интеграции и увеличивается объём данных.

Иначе говоря, перед запуском стоит проверять не только то, тянет ли сервер модель, но и готова ли вся схема к реальной жизни. Запустить LLM на VPS можно быстро. Сложнее — сделать так, чтобы через месяц этот запуск не превратился в набор срочных доработок вокруг когда-то удачной демки.

Заключение

Вот мы и разобрали, почему VPS для AI и LLM-нагрузок — это не история про “взять сервер помощнее и надеяться на лучшее”. В таких сценариях всё решает связка: что именно делает модель, во что упирается ваш сервис, как устроены данные, что происходит в сети и выдержит ли вся схема рост после первой удачной демки.

Именно поэтому хороший выбор начинается не с красивого тарифа, а с куда более приземлённого вопроса: какой у вас сценарий и что ему реально нужно. Где-то хватит аккуратно подобранного VPS или GPU-VPS, а где-то уже на старте станет ясно, что задача требует совсем другого класса инфраструктуры.