Термины и контекст: что такое observability и чем оно отличается от “мониторинга”

Представьте повседневную ситуацию. У вас дома внезапно пропал интернет. На роутере лампочки горят, “интернет” вроде как есть, но сайты открываются через раз. Что делает большинство людей? Проверяет одно: “сеть вообще жива?” — перезагружает роутер, смотрит, есть ли связь, меряет скорость, звонит провайдеру. Это и есть мониторинг в бытовом смысле: набор проверок “работает/не работает” и несколько чисел, которые показывают, что система в целом жива.

А теперь представьте, что вы хотите понять не просто “жив ли интернет”, а почему он иногда исчезает. Проблема в роутере? В провайдере? В конкретном устройстве? В перегруженном Wi-Fi канале? В том, что телевизор качает обновление и забивает канал? Тут одного “интернет есть/нет” уже недостаточно. Вам нужен контекст: что происходило в момент сбоя, на каком участке начались потери, кто “съел” пропускную способность, где выросли задержки.

Вот это и есть observability (наблюдаемость).

Если мониторинг отвечает на вопрос “всё ли сейчас в порядке?”, то observability отвечает на другой вопрос: “почему не в порядке, если стало плохо?” И не в теории, а так, чтобы вы могли сделать вывод на основе данных.

В IT это особенно важно, потому что современные системы редко бывают “одним сервером”. Даже относительно простой интернет-магазин мониторов обычно состоит из нескольких частей: сайт, API, база данных, платежи, склад/наличие, доставка, уведомления. Пользователь видит одну кнопку “Оформить заказ”, а внутри это цепочка запросов между сервисами. И если “что-то тормозит”, мониторинг может честно показать: “сервисы живы, CPU нормальный, ошибок немного”. Но пользователь всё равно будет видеть зависания.

Observability нужна именно для таких ситуаций — когда проблема не выглядит как “всё упало”, а проявляется как деградация: иногда медленно, иногда только у части пользователей, иногда только на одном шаге (например, на оплате), иногда только в часы пик.

И ещё важный момент: observability — это не “ещё один дашборд”. Это свойство системы и культуры работы: вы заранее делаете так, чтобы по данным можно было восстановить картину происходящего. Чтобы, когда кто-то пишет “у нас checkout подвисает”, вы не гадали, а могли быстро ответить: где началась задержка, какой сервис виноват, что изменилось и почему это произошло именно сейчас.

Три сигнала: метрики, логи и трейсы — что каждый даёт

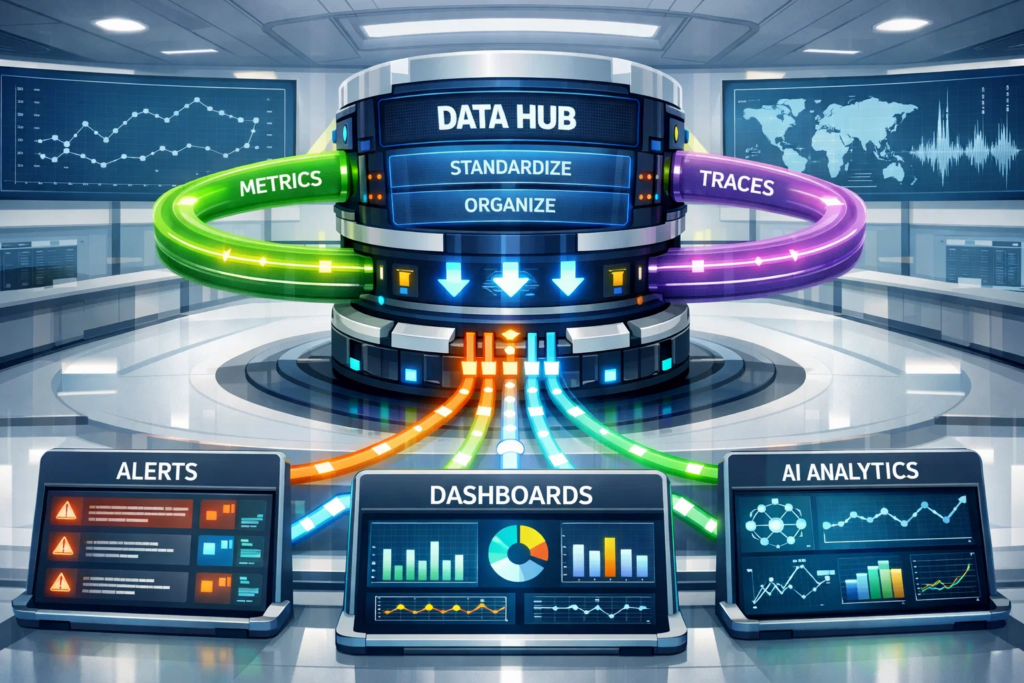

Теперь переходим к тому, на чём observability держится практически везде: три сигнала — метрики, логи и трейсы. Они часто звучат как набор терминов, но на деле это три разных “угла обзора” на одну и ту же реальность. И если у вас есть только один угол, вы будете постоянно гадать.

Для упрощения вернёмся к нашему магазину. Пользователь жалуется: “оформление заказа иногда зависает”. С точки зрения бизнеса это одна проблема. Но чтобы понять причину, вам нужны разные типы данных — и тут как раз включаются три сигнала:

- Метрики показывают картину в целом: сколько запросов приходит, сколько ошибок происходит, какие задержки и сколько ресурсов потребляется. Это быстрые графики и числа, которые отвечают на вопросы “стало хуже или лучше?” и “когда именно началось?”. Например: выросло ли время ответа на шаге оформления заказа, увеличилось ли число серверных ошибок, упёрлись ли мы в лимиты базы данных, начались ли таймауты при обращении к внешнему платёжному сервису.

- Логи показывают, что произошло в конкретном случае: события и детали. Это записи, по которым можно понять “почему” — какая именно ошибка случилась и при каких условиях. Например: отказ в доступе, исключение в приложении, таймаут при обращении к сервису проверки наличия на складе, параметры запроса, идентификатор заказа. Логи полезны не только для ответа “что сломалось”, но и чтобы восстановить последовательность событий вокруг проблемы.

- Трейсы показывают, как прошёл путь одного запроса через систему: по каким сервисам он прошёл и где именно потратил время. Это особенно важно в микросервисах и распределённых системах. Для нашего checkout трейсы отвечают на вопрос: задержка возникла в самом API магазина, в обращении к базе, в сервисе наличия, в оплате или в доставке? И сколько времени ушло на каждый шаг?

Если говорить совсем просто: метрики дают “карту погоды”, логи — “историю события”, а трейсы — “маршрут движения”.

И вот почему в 2026 “по отдельности” это уже слабая стратегия. Метрики могут показать, что всё стало медленнее, но не скажут почему. Логи могут сказать почему, но вы утонете в них без контекста “когда и где”. Трейсы могут показать узкое место, но без метрик вы не увидите, насколько это массовая проблема, а без логов не поймёте причину ошибки внутри конкретного шага.

Корреляция и контекст: почему “по отдельности” уже не работает

Итак, метрики показывают картину в целом, логи дают детали, трейсы показывают маршрут запроса. Но есть проблема: если эти три штуки живут отдельно, вы каждый раз играете в “угадайку”.

В магазине это выглядит так. Метрики говорят: “в 19:10 выросла задержка на checkout”. Окей. Вы лезете в логи — а там тысячи строк в минуту. Вы начинаете искать “timeout”, находите несколько сообщений, но не уверены: это причина или просто шум. Потом открываете трейсы, видите, что часть запросов тормозит на шаге “inventory”, а часть — на “payments”. И снова вопрос: это две разные проблемы или одна, просто проявляется по-разному?

Вот здесь и появляется ключевая идея observability: корреляция.

Корреляция — это когда вы можете связать метрику, лог и трейс не “по времени на глаз”, а по общему контексту. Обычно это делается через идентификаторы: request id, trace id, session id, order id — всё, что позволяет сказать: “вот конкретный запрос пользователя, вот его трейс, вот логи именно этого запроса, и вот метрики, которые показывают, насколько это массово”.

Тогда расследование перестаёт быть археологией.

Вы видите всплеск задержки на графике. Кликаете по нему и переходите к выборке трейсов за этот интервал. Открываете один “медленный” трейс и сразу понимаете: 2 секунды ушло на обращение к inventory, потому что там начались таймауты к базе. И дальше — самое важное — по trace id вы открываете логи именно этого запроса и видите конкретную причину: например, увеличилась очередь запросов, или база начала отвечать медленно из-за блокировок. И уже потом метрики помогают ответить на бизнес-вопрос: “это редкий случай или массовая деградация?”, “затронуло всех или только часть регионов?”, “как быстро ухудшается?”.

Вот что такое observability “взрослого уровня”: не отдельные источники данных, а единая связанная история.

И ещё один момент, который многие недооценивают: контекст — это не только идентификаторы. Это ещё и метаданные, которые делают данные полезными. Например: какой endpoint, какой сервис, какой регион, какой клиент, какая версия приложения, какой тип ошибки. Без этого у вас есть море логов и трейсов, но вы не можете их резать по смыслу.

Поэтому в современных системах “голые логи” и “голые метрики” считаются слабой практикой. Нужны структурированные события и единый контекст. Тогда вы можете задавать нормальные вопросы: “покажи все медленные запросы checkout за последние 10 минут для версии 1.8”, “покажи ошибки оплаты только для одного провайдера”, “покажи, где растёт очередь”.

Дальше логичный вопрос: как сделать так, чтобы метрики, логи и трейсы действительно собирались одинаково и связывались между собой, а не превращались в набор разрозненных интеграций? Тут на сцену выходит OpenTelemetry.

OpenTelemetry: зачем нужен стандарт и как он собирает телеметрию

OpenTelemetry (OTel) — это попытка навести порядок в том, как эти сигналы собираются и передаются. Потому что без стандарта observability быстро превращается в зоопарк: один сервис шлёт метрики одним агентом, логи собираются другим, трейсы — третьим, форматы разные, контекст теряется, а миграция на другой стек выглядит как капитальный ремонт.

Зачем вообще нужен стандарт? По той же причине, по которой нужны общие разъёмы и протоколы. Вам важно, чтобы телеметрия не “прилипала” к одному вендору или одному инструменту навсегда. OpenTelemetry делает телеметрию переносимой: вы собираете данные единым способом, а дальше можете отправлять их туда, где вам удобно анализировать — сегодня в одну систему, завтра в другую.

Как OpenTelemetry собирает телеметрию, если объяснять простыми словами?

Во-первых, OTel даёт инструментацию — то есть способ “вшить” в приложение сбор телеметрии. Это может быть автоматическая инструментация (когда библиотека сама подхватывает популярные фреймворки и протоколы) или ручная (когда вы сами размечаете ключевые места: например, checkout, payments, inventory). В нашем магазине мониторов это выглядит естественно: вы хотите видеть, сколько времени реально занимает “оформление заказа” и где оно тормозит — значит, добавляете трассировку вокруг этого пути.

Во-вторых, OpenTelemetry работает с контекстом. Это критично: он умеет “пронести” trace id и связанные атрибуты через цепочку вызовов между сервисами. То есть, когда запрос проходит через frontend - API - inventory - payments, все куски цепочки могут быть связаны в один трейс, а логи можно привязать к тому же идентификатору. Именно это превращает “три сигнала” в одну историю, а не в три отдельные вселенные.

В-третьих, у OTel есть понятие “точки сборки” — collector. Если не усложнять, collector — это промежуточный слой, который принимает телеметрию от приложений, может её фильтровать/обогащать/преобразовывать и отправлять дальше в нужные системы хранения и анализа. Это удобно по двум причинам: приложениям не нужно знать “куда именно шлём данные” (они шлют в collector), и вы можете менять backend без переписывания всей инструментализации.

Если снова вернуться к нашему магазину: у вас десятки компонентов. Без стандарта каждый из них мог бы собирать данные “как получилось”. С OpenTelemetry вы приводите всё к одному языку: метрики, логи и трейсы собираются единым подходом, несут одинаковый контекст и дальше спокойно маршрутизируются туда, где вы их анализируете.

И вот почему OpenTelemetry в 2026 — это почти “дефолтный выбор”: он не обещает магии, но даёт главное — единый стандарт сбора и корреляции. А уже поверх него вы выбираете любые инструменты визуализации, алертов и хранения.

Если подвести итог всей темы: observability — это не просто графики. Это способность быстро ответить “что случилось и почему”, а OpenTelemetry — один из самых практичных способов сделать эту способность системной, а не случайной.

Заключение

Observability — это не “ещё один мониторинг”, а способность быстро и уверенно ответить на два вопроса: что сломалось и почему. В современных системах этого не добиться одним графиком и парой алертов — нужна связная картина из метрик, логов и трейсов, которые смотрят на проблему с разных сторон.

Решающее слово здесь — контекст. Когда у вас есть общий идентификатор запроса и нормальная корреляция, расследование превращается из археологии в понятный маршрут: увидел деградацию на метриках - открыл трейсы - подтвердил причину в логах.

А OpenTelemetry в этой истории — не “очередная модная штука”, а практичный стандарт, который помогает собирать телеметрию единым способом и не привязывать наблюдаемость к одному инструменту навсегда. В 2026 это, по сути, базовая инвестиция в то, чтобы система была не только работающей, но и объяснимой.

Спасибо за внимание!